سلام

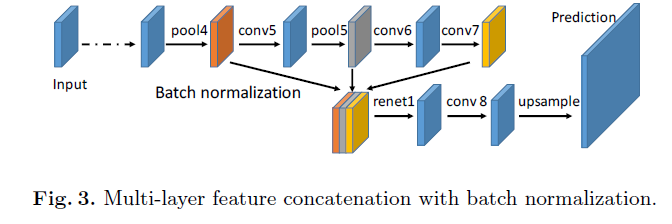

این ساختار معماری Renet هست

1- اون قسمت که باید سه لایه با هم concat و batchnorm بشن رو نمیدونم چطور پیاده کنم

لینک مقاله

اگر درست متوجه شده باشم لایه 14و18و21 رو باید با هم یکی کرد

این شکلی درسته با توجه به مدلی که در آخر اومده ؟

concatenated = keras.layers.concatenate([lay6,lay5_2,lay4_2],axis=3)

ولی خطا میده

ValueError: `Concatenate` layer requires inputs with matching shapes except for the concat axis. Got inputs shapes: [(None, 10, 25, 128), (None, 10, 25, 128), (None, 19, 50, 64)]

فکر کنم باید سه لایه رو یک شکل کرد ولی نمیدونم چجوری محاسبه میشهReshape شون؟

2- Upsample برای چی استفاده میشه ؟ و چرا تو لایه ی آخر ؟

مدل :

input_img = Input(shape=(width, height,1))

lay1 = Conv2D(32, (3, 3), padding='same', activation='relu')(input_img)

lay1_2 = MaxPooling2D(pool_size=(2, 2),padding='same')(lay1)

lay1_3=Dropout(0.2)(lay1_2)

lay2 = Conv2D(32, (3, 3), padding='same', activation='relu')(lay1_3)

lay2_2 = MaxPooling2D(pool_size=(2, 2),padding='same')(lay2)

lay2_3=Dropout(0.2)(lay2_2)

lay3 = Conv2D(64, (3, 3), padding='same', activation='relu')(lay2_3)

lay3_2 = MaxPooling2D(pool_size=(2, 2),padding='same')(lay3)

lay3_3=Dropout(0.2)(lay3_2)

lay4 = Conv2D(64, (3, 3), padding='same', activation='relu')(lay3_3)

lay4_2 = MaxPooling2D(pool_size=(2, 2),padding='same')(lay4)

lay4_3=Dropout(0.2)(lay4_2)

lay5 = Conv2D(128, (3, 3), padding='same', activation='relu')(lay4_3)

lay5_2 = MaxPooling2D(pool_size=(2, 2),padding='same')(lay5)

lay5_3=Dropout(0.2)(lay5_2)

lay6 = Conv2D(128, (3, 3), padding='same', activation='relu')(lay5_3)

lay6_2 = MaxPooling2D(pool_size=(2, 2),padding='same')(lay6)

lay6_3=Dropout(0.2)(lay6_2)

concatenated = keras.layers.concatenate([lay6,lay5_2,lay4_2],axis=3)